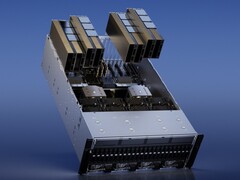

AI-bedrijven in China, die te maken hebben met hindernissen in de regelgeving en exportbeperkingen, maken steeds vaker gebruik van gereviseerde en gebruikte Nvidia-accelerators. Toen de export van H20 werd hervat in juli, bemoeilijkten nieuwe Chinese regels voor gegevensbeveiliging de aanschaf van Nvidia's beperkte Hopper-kaart. Als gevolg hiervan wendden kopers zich tot oudere A100- en H100-kaarten, die nu door verkopers worden gereviseerd en verkocht voor betaalbare inferentieclusters met hoge prestaties.

Inferentie vereist minder rekenwerk dan training en heeft geen volledige floating-point precisie nodig. Een A100 uit 2020 biedt tot 80 gigabyte HBM2e en ongeveer 2 TBps aan bandbreedte. Het draait chatbots en aanbevelingsengines nog steeds goed. De volwassen CUDA-software van Nvidia helpt, gezien het ontwikkelingsniveau van de stack. Voor teams die zich richten op het bedienen van modellen, in plaats van ze te trainen, is ouder silicium een slimme investering.

Ter vergelijking, de H100 de prestaties, met HBM3 en een veel hogere verwerkingscapaciteit. De H20 voldoet aan de exportregels, maar de AI-prestaties zijn ruwweg drie tot zeven keer lager dan die van een volledige H100, en meer dan dertig keer lager in dubbele precisie. Gezien deze beperkingen kiezen veel kopers in China nog steeds voor hergebruikte H100-kaarten in plaats van nieuwe H20-eenheden.

Inferentiesystemen kunnen continu draaien met minimale risico's voor de nauwkeurigheid, en oudere CUDA-compatibele kaarten zijn gemakkelijk inzetbaar. Er blijft veel vraag naar gereviseerde kaarten, ondanks enige bezorgdheid over de betrouwbaarheid. Datacenters kunnen onmiddellijk uitbreiden in plaats van te wachten op goedgekeurde onderdelen.

Ondertussen staat Nvidia voor een moeilijke situatie: wijzigingen in de Amerikaanse licentieregels hebben geleid tot een afschrijving van $5,5 miljard waardevermindering van $5,5 miljard op onverkochte H20 voorraden. Tegelijkertijd betekent de schaarste aan officiële kaarten dat oudere Nvidia GPU's de Chinese AI-groei blijven voeden via onofficiële en opgeknapte verkopen. Deze dynamiek kan de winst van Nvidia beïnvloeden en de adoptie van nieuwe technologie vertragen.

Op het binnenlandse front stimuleert de Chinese overheid binnenlandse versnellers van Huawei en Birenmaar elke tweedehandse H100 of getunede A100 die in Chinese datacenters wordt ingezet, verkleint de markt voor Ascend-gebaseerde systemen en vertraagt investeringen in stacks van eigen bodem.

Samen creëren deze regels een kringloopeconomie. Controles die geavanceerd computergebruik beperken en beleid dat lokale chips promoot, houden oudere Nvidia-hardware langer bruikbaar.

Bron(nen)

DigiTimes (in Engels)

Top 10 Testrapporten

» Top 10 Multimedia Notebooks

» Top 10 Gaming-Notebooks

» Top 10 Budget Gaming Laptops

» Top 10 Lichtgewicht Gaming-Notebooks

» Top 10 Premium Office/Business-Notebooks

» Top 10 Budget Office/Business-Notebooks

» Top 10 Workstation-Laptops

» Top 10 Subnotebooks

» Top 10 Ultrabooks

» Top 10 Notebooks tot €300

» Top 10 Notebooks tot €500

» Top 10 Notebooks tot € 1.000De beste notebookbeeldschermen zoals getest door Notebookcheck

» De beste notebookbeeldschermen

» Top Windows Alternatieven voor de MacBook Pro 13

» Top Windows Alternatieven voor de MacBook Pro 15

» Top Windows alternatieven voor de MacBook 12 en Air

» Top 10 best verkopende notebooks op Amazon

» Top 10 Convertible Notebooks

» Top 10 Tablets

» Top 10 Tablets tot € 250

» Top 10 Smartphones

» Top 10 Phablets (>90cm²)

» Top 10 Camera Smartphones

» Top 10 Smartphones tot €500

» Top 10 best verkopende smartphones op Amazon